Kiderült, hogy meglepően hasonló módon gondolkoznak a mély neurális hálók

A biológiai neurális hálók mesterséges változatai nagy szerepet játszanak a gépi tanulásban és ezáltal a nyelvfeldolgozási vagy képfelismerő programokban, vagyis a mesterséges intelligencia olyan alkalmazási területein, amelyek ma már a mindennapok részét alkotják. A mély neurális hálók bonyolult, többrétegű struktúrát alkotnak és számos formát felvehetnek, attól függően, hogy milyen elrendezéssel, mérettel vagy éppen optimalizálási metódussal alakítják ki őket. Egy új tanulmány szerint azonban a mélyben nagyon hasonló mintázatok fedezhetőek fel a tanulási folyamat tekintetében, azaz a hálózatok meglepően hasonlóan "gondolkodnak".

A gondolkozás egy mesterséges rendszer esetében persze nem az emberivel egyenértékű értelmi tevékenységet jelent, hanem annak a műveletnek a megvalósulását, aminek következtében a rendszer képessé válik nagy pontossággal felismerni és osztályozni a betáplált vizuális vagy nem vizuális adatokat. Ennek a procedúrának a lefolyását vizsgálták a Cornell Egyetem, a Pennsylvania Egyetem és a Brigham Young Egyetem kutatói, egy olyan technikával, amit korábban az univerzum és a lehetséges univerzumok feltérképezéséhez és összehasonlításához fejlesztettek ki. A Cornell Egyetem által replika teóriának nevezett módszerrel egy magas dimenziójú (bonyolultabb) térben lehetséges alacsony dimenziójú mintázatokat kimutatni, így a neurális hálók betanítása során létrehozott komplex rendszerben is követni tudták a tanulás menetét.

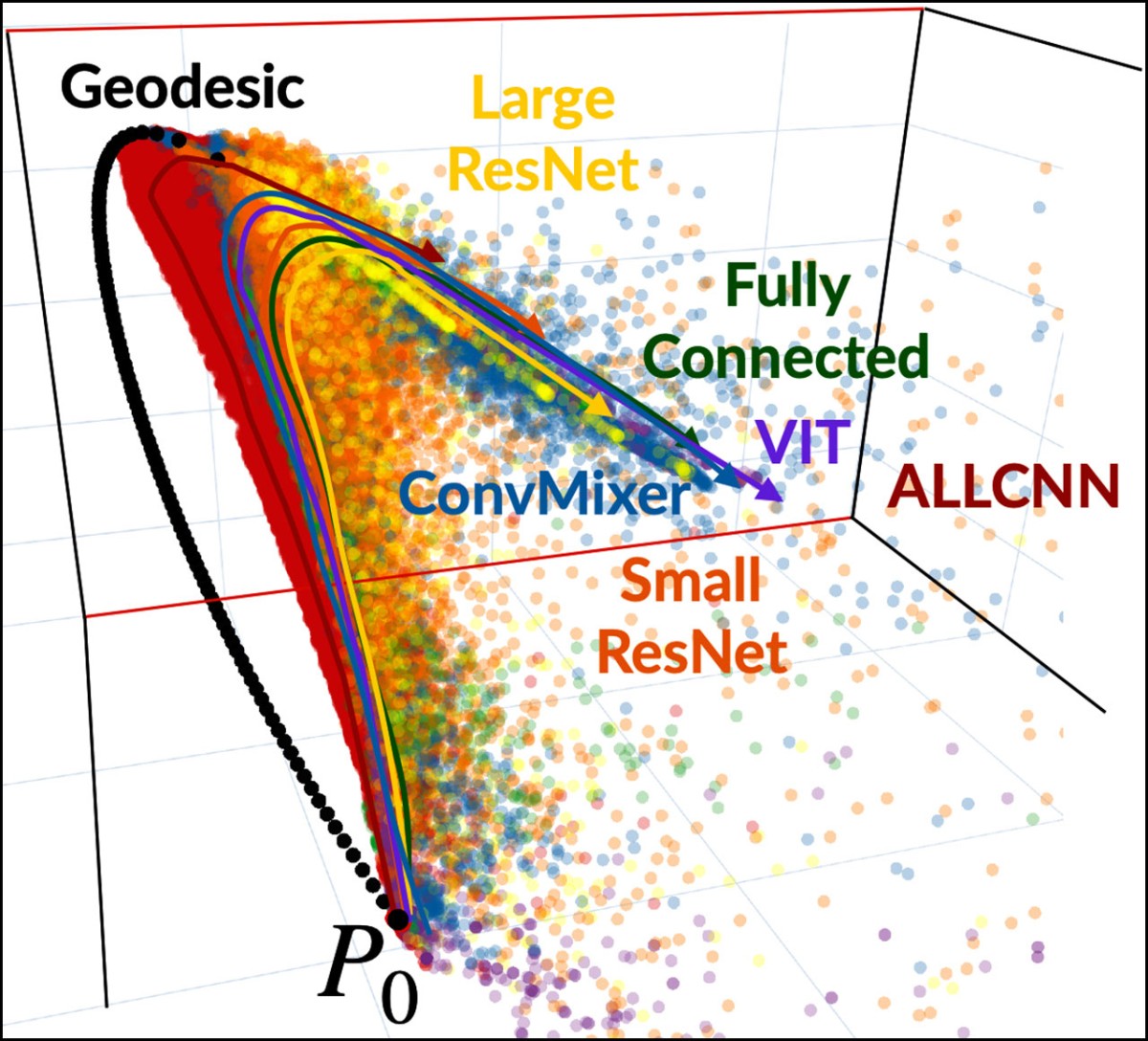

A kísérletben hatféle neurális háló típust figyeltek meg: az úgynevezett teljesen összekötött neurális hálót, az All-CNN konvolúciós neuronhálót, a Small ResNet és Large ResNet reziduális hálózatokat, a ConvMixer neurális hálót és a ViT (Vision Transformer) transzformer neurális hálózatot. A hálókat különféle méretben, paraméterrel és szabályozási metódussal alkották meg, összesen 2296 konfigurációban. A betanításhoz 50 000 képet használtak fel, amelyeket a neurális hálóknak 10 kategóriába kellett besorolniuk, vagyis el kellett dönteniük, hogy a látott képen szereplő objektum egy repülőgép, autó, hajó, teherautó, vagy esetleg madár, macska, kutya, béka, szarvas vagy ló. Az ötvenezer kép és a tíz kategória összesen félmillió dimenziós teret képviselt. Ebben a magas dimenziójú térben a megfigyelések szerint a hálózatok nagyon hasonló alakzatú pályát jártak be, ami elvezette őket a képek felismeréséhez.

A tanulási pályái a különböző felépítésű mély neurális hálóknak a probabilisztikus elosztás feltűnően alacsony dimenziós terében játszódnak le

- írják a tanulmányban a kutatók.

A neurális hálók működésének megértése a későbbi fejlesztések szempontjából fontos lehet és a kutatók által használt módszerrel megfigyelhetővé válik, hogy a legsikeresebb hálózatok valójában hogyan tanulnak és milyen jellemzők kötik össze őket. Ez pedig elvezetheti a mérnököket a még hatékonyabb rendszerek megalkotásához, amelyek a következő generációs modelleket működtetik majd.

(Fotó: David_SMC/Pixabay, Cornell Egyetem)