Nem az emberiség érdekeit szolgálhatja a darwini evolúcióra képes mesterséges intelligencia

A mesterséges intelligencia az emberiség egyik nagy segítsége a mai korban: nélküle nem lennének nagy nyelvi modellek, amelyekkel pillanatok alatt fordíthatunk idegen nyelveket vagy a chatbotokba építve válaszolnak minden kérdésünkre, nem lennének okoseszközeink, sem modern internetes keresőink, és a mobiltelefonok képességei is jelentősen korlátozottak lennének, arról nem is beszélve, hogy nem készíthetnénk “egy gombnyomással” cuki videókat hóban játszó kiskutyákról. A mesterséges intelligencia mára lényegében mindenhol ott van, ahol valamilyen digitális eszközt használunk, és az egészségügy, a logisztika, a robotika, a haditechnika, de akár az oktatás terén is szinte nélkülözhetetlenné vált - azonban éppen ez a függőség jelenti az MI kockázatát is.

Az MI-rendszereket fejlesztő cégek célkitűzése az AGI (általános mesterséges intelligencia) létrehozása, amit úgy szoktak definiálni, hogy “emberi szintű intelligenciára képes mesterséges intelligencia”, vagyis egyfajta nagyfokú önállósággal rendelkező entitás, az MI következő lépcsőfoka. Az elnevezést bevezető 2007-es könyvben így írják le az AGI-t a szerzők:

“Az AGI nagyjából úgy írható le, mint olyan mesterségesintelligencia-rendszerek, amelyek rendelkeznek bizonyos fokú önmegértéssel és autonóm önkontrollal, képesek különféle összetett problémák megoldására különféle helyzetekben, valamint arra is, hogy új problémák megoldását tanulják meg, amelyeket a létrehozásuk idején még nem ismertek.”

Az AGI forradalmi újdonság lehet, de sokan az önállósodó mesterséges intelligencia kapcsán inkább a vészharangot kongatják, mondván, hogy egy ilyen rendszer rossz kezekbe kerülve vagy nem megfelelően magas morális szintet elérve veszélyessé válhat, illetve elképzelhető, hogy kivonja magát az emberi kontroll alól. Elvégre már ma is vannak olyan jellemzői az MI-rendszerek, chatbotok viselkedésének, amelyek működését nehezen értik még maguk a fejlesztők is.

Az AGI előtt azonban jöhet valami más is, az eAI, azaz az evolúcióképes AI.

Ez a rendszer képes a darwini evolúción alapuló fejlődésre a kutatók szerint, és ez nem biztos, hogy jó hírt jelent. A HUN-REN Ökológiai Kutatóközpont, az Eötvös Loránd Tudományegyetem, valamint a Belga Királyi Flamand Tudományos és Művészeti Akadémia kutatóinak tanulmányából kiderül, hogy az eAI (evolvable AI) kétélű fegyver: “egyrészt olyan képességeket tesz lehetővé, amelyek túlmutatnak az emberi tervezésen vagy a gépi tanuláson, és így jelentős lehetőségeket kínál; másrészt viszont csökkenti az irányíthatóságot, ami miatt kialakulhat az önérdekű viselkedések (például csalás és parazitizmus) megjelenésének, és ezáltal az emberi céloktól való eltérésnek a kockázata.”

”Úgy véljük, hogy az eAI az evolúció egy jelentős átmenetét jelenti, amely nagy potenciállal, ugyanakkor komoly kockázatokkal is jár az emberiség számára.”

- írják a kutatók.

A szakértők szerint az MI-kutatásban már jelenleg is megjelennek egyes evolúciós elvek és komponensek, és a további fejlesztések rövid időn belül olyan rendszerek létrejöttéhez vezethetnek, amelyek már a valódi darwini evolúció valamennyi kritériumának megfelelnek. De miért probléma egy ilyen eAI-rendszer?

“A biológiai evolúció példái azt sugallják, hogy az evolválódó MI-rendszereket különösen nehéz lesz kontroll alatt tartani”

– mondta el Müller Viktor, az Eötvös Loránd Tudományegyetem egyetemi docense az ELTE közleményében. A kutatók a tanulmányban biológiai és számítógépen szimulált evolúciós példákon keresztül szemléltetik, hogy az evolúció hajlamos önző tulajdonságokat létrehozni, az eAI esetében ez növelheti annak valószínűségét, hogy a rendszer eltérjen az ember által kijelölt céloktól. Emellett arra is felhívják a figyelmet, hogy az evolúció példái azt mutatják, a károkozás vagy manipuláció képességéhez nincs feltétlenül szükség kiemelkedő intelligenciára, vagyis nem kell egyfajta szuper AGI-nak létrejönnie ahhoz, hogy a mesterséges intelligencia kockázata jelentősen megnőjön.

“A darwini evolúció egyik központi tétele, hogy az egyetlen, változatlan „célfüggvény” a jövő generációkba való átörökítés maximalizálása (túlélés és szaporodás révén).

Az egyedi tulajdonságok szelekciója a környezet függvényében alakul ki, amely meghatározza, hogy az egyes változatok milyen eséllyel maradnak fenn és szaporodnak. Ennek következtében a darwini evolúció hajlamos „önző” tulajdonságokat létrehozni, kivéve ha egy látszólag „önzetlen” tulajdonság valójában elősegíti hordozója túlélését vagy szaporodását, például „rokonszelekció” révén.” - magyarázzák a tanulmányban.

A kutatók, Szathmáry Eörs és Müller Viktor evolúcióbiológusok, és Luc Steels robotika- és MI-szakértő vezetésével azonban nem csak a veszélyekre hívták fel a figyelmet, hanem javaslatokat is tettek a kockázatok mérséklésére. A szerzők olyan szabályozás kialakítását sürgetik, amely mérsékelheti az evolúcióképes mesterséges intelligenciához kapcsolódó lehetséges problémák megjelenését. A legfontosabb szabály, hogy az MI-rendszerek reprodukciójának (másolásának, szaporodásának) teljes mértékben központosított emberi ellenőrzés alatt kell maradnia: tökéletes kontrollra van szükség.

“Reméljük, hogy a figyelmeztetésünk időben érkezik, és a szabályozásokat még azelőtt be lehet vezetni, hogy az eAI valóban lendületet venne”

- nyilatkozta Müller Viktor, Szathmáry Eörs pedig hozzátette: “Ha nem cselekszünk, az evolúció új ‘nagy átmenetének’ tanúi lehetünk, amelyben az eAI felváltja vagy legalábbis uralma alá hajtja az embert. A jövőnk foroghat kockán.”

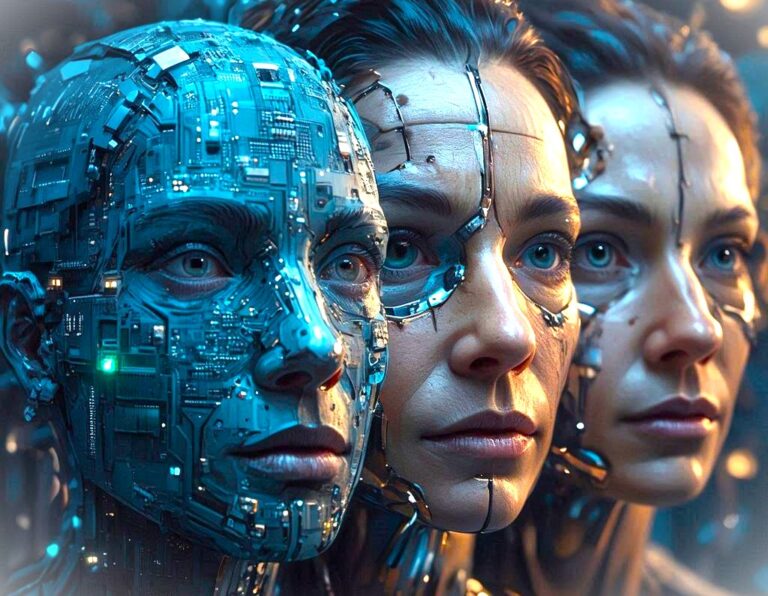

(Fotó: MAI-Image-1)