Lefotózta a beteg gyerekét, a Google pedofíliának nézte és értesítette a hatóságokat

A The New York Times-nál Kashmir Hill írt egy részletes riportot arról, hogy egy kaliforniai és egy texasi édesapa hogyan veszítette el a digitális életének legfontosabb elemeit, miután a Google tévedésből pedofil tartalomként azonosított általuk készített képeket. Markkal és Cassioval gyakorlatilag ugyanaz történt: a kisgyermekük ágyékán irritációkat fedeztek fel, majd miután egyeztettek a gyerekorvossal, annak a kérésére lefényképezték az érintett területeket. A fényképek segítségével a kisfiúkon tudtak segíteni, de a szüleik sokkal nagyobb problémák között találták magukat.

Lezárt email-fiók, elveszett fotók, felmondott mobil-előfizetés

Mark két nappal a fotók elkészítése és elküldése után egy értesítést látott az Android telefonján: zárolták a fiókját, mert megsértette a felhasználási feltételeket. A lehetséges okok között szerepelt a gyermekbántalmazási tartalmak terjesztése, így a férfinak leesett a tantusz, és gyorsan kapcsolatba lépett az ügyfélszolgálattal, ahol indoklás nélkül fenntartották az álláspontjukat. Mindeközben észrevette, hogy a levelei mellett a teljes névjegyzéke és telefonszámai, valamint a Google-nél tárolt fotói is elvesztek. Sőt, mivel a cég az Egyesült Államokban mobilszolgáltatást is értékesít, és a férfi pechjére pont ott volt előfizető, a száma is elveszett, vagyis nem tudta megkapni a más szolgáltatásokhoz szükséges SMS-kódokat. Cassioval gyakorlatilag ugyanez történt.

Fél évvel később Markot levélben értesítette a helyi rendőrség, hogy nyomoztak utána

Végigböngészték a kereséseit, az üzeneteit, a fotóit és videóit, ahogyan azt is, hogy merre járt. A nyomozást lezárták, tisztázták a gyanú alól - de a Google ettől függetlenül nem állítja vissza sem az ő, sem Cassio fiókját. Évek adatai veszhettek el örökre, de a cég mindettől függetlenül azt nyilatkozta a Times-nak, hogy "kiállnak a döntéseik mellett". A képviselőjük azt mondta, hogy nem látták a bőrirritációt Mark felvételein, sőt, egy videót is találtak, amelyen egy kisgyermek egy meztelen nő mellett fekszik az ágyban. Mark nem emlékszik a fájlra, de úgy sejti, hogy meg akarhatott örökíteni egy idilli reggelt. "Bárcsak pizsamában aludtunk volna" - teszi hozzá.

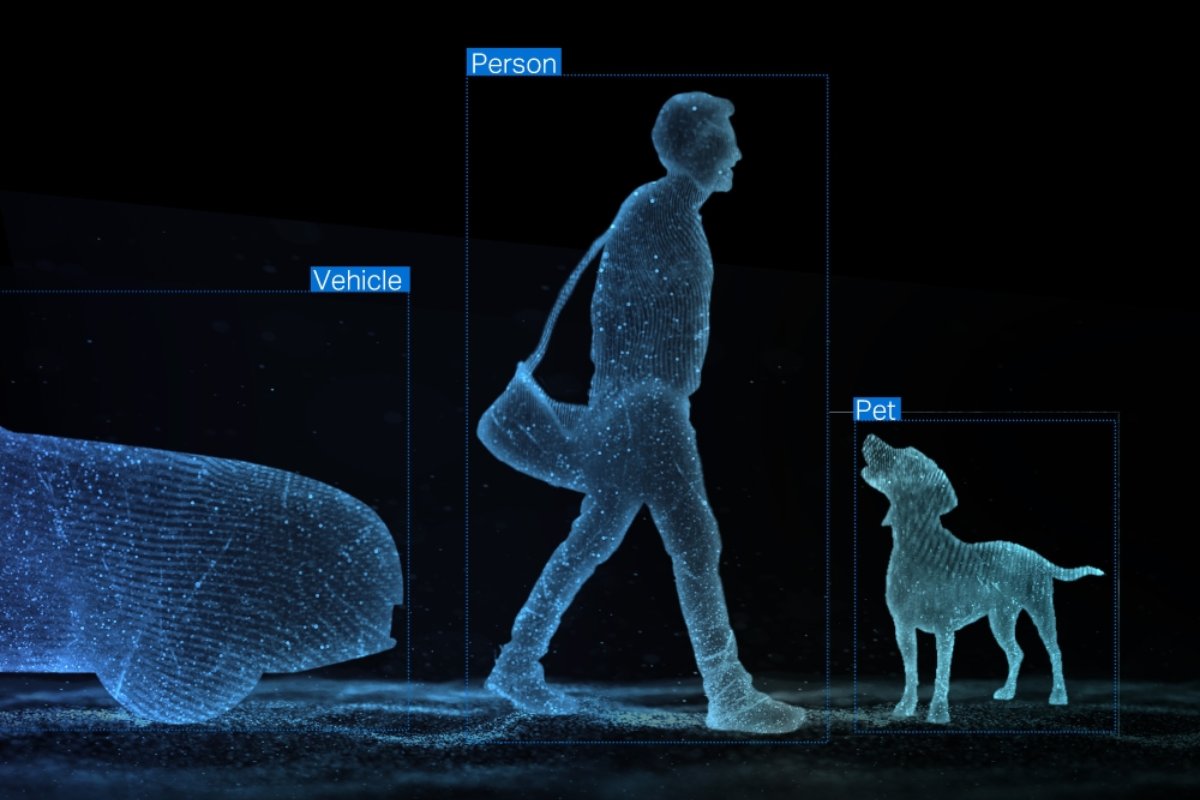

A Rakétán korábban többször írtunk arról, hogy a technológiai nagyvállalatok hogyan próbálnak rátalálni a gyermekbántalmazással kapcsolatos felvételekre, hogy aztán értesíthessék a hatóságokat. A legjellemzőbb, hogy a gyermekvédelem által már azonosított, bizonyítottan illegális videókat, képeket keresik a hozzájuk feltöltött milliárdnyi fájl között, például az üzenetekben vagy a felhőben tárolt biztonsági másolatokban. Ezt egészítik ki olyan mesterséges intelligenciákkal, amelyek az új fotókról, videókról próbálják megállapítani, hogy törvénysértőek-e.

Az Apple tavaly egy olyan rendszert javasolt, amely közvetlenül a készüléken tenné meg ugyanezt: megkapják az említett adatbázist a gyermekvédelmi szervektől, amely tartalmazza az ismert pornográf fájlok "digitális ujjlenyomatait". Ezt egy bonyolult eljárással titkosítják, majd letöltik az iPhone-okra, iPadekre, Mac-ekre. Ott aztán minden egyes felhasználói fotó kap egy tanúsítványt, ami rögzíti, hogy ismert jogsértő tartalom szerepel-e rajta. Amikor a felhasználó feltölti a felhőbe a képeket, például, hogy biztonsági másolatot készítsen róluk, a rendszer értesíti az Apple-t, ha egy meghatározott mennyiségnél több aggasztó tartalmat talál. Az Apple dolgozói ekkor és csak ekkor betekinthetnek a képekbe (ezt eddig is megtehették, ahogy minden más nagy felhőszolgáltatónál is), és ha valóban fennáll a probléma, jelzik a hatóságoknak.

Azonban az új technológia bevezetését végül bizonytalan ideig elhalasztották, miután jogvédők jelezték, hogy szerintük nem tartja tiszteletben a felhasználók magánszféráját, illetve bizonyos országokban a hatóságok akár vissza is élhetnek azzal. Vagyis a tökéletes, vagy szinte tökéletes megoldás egyelőre várat magára, miközben csak az Egyesült Államok gyerekvédelmi központja napi nyolcvanezer bejelentést kap illegális, gyermekbántalmazást ábrázoló tartalmak miatt.

(Fotó: Unsplash)