Az Apple feladta a magánszféra védelmét a pedofília elleni küzdelem jegyében?

Csütörtökön a 9to5Mac még csak sejtette, amit később az Apple hivatalosan is megerősített: az amerikai Apple-felhasználók fájljait egy új mesterséges intelligencia fogja átfésülni, hogy felismerje, majd ha szükséges, jelentse a jogsértő tartalmakat a hatóságoknak.

A NeuralHash nevű rendszer bevezetése két, nehezen összeegyeztethető jelenséget próbál figyelembe venni egyszerre: a cég évek óta azt kommunikálja, hogy a vásárlói privát szférája szent és sérthetetlen; közben a kormányok irányából egyre nagyobb a nyomás, hogy a titkosítottan kommunikáló csatornák tartalmába belenézhessenek.

Hogyan működik?

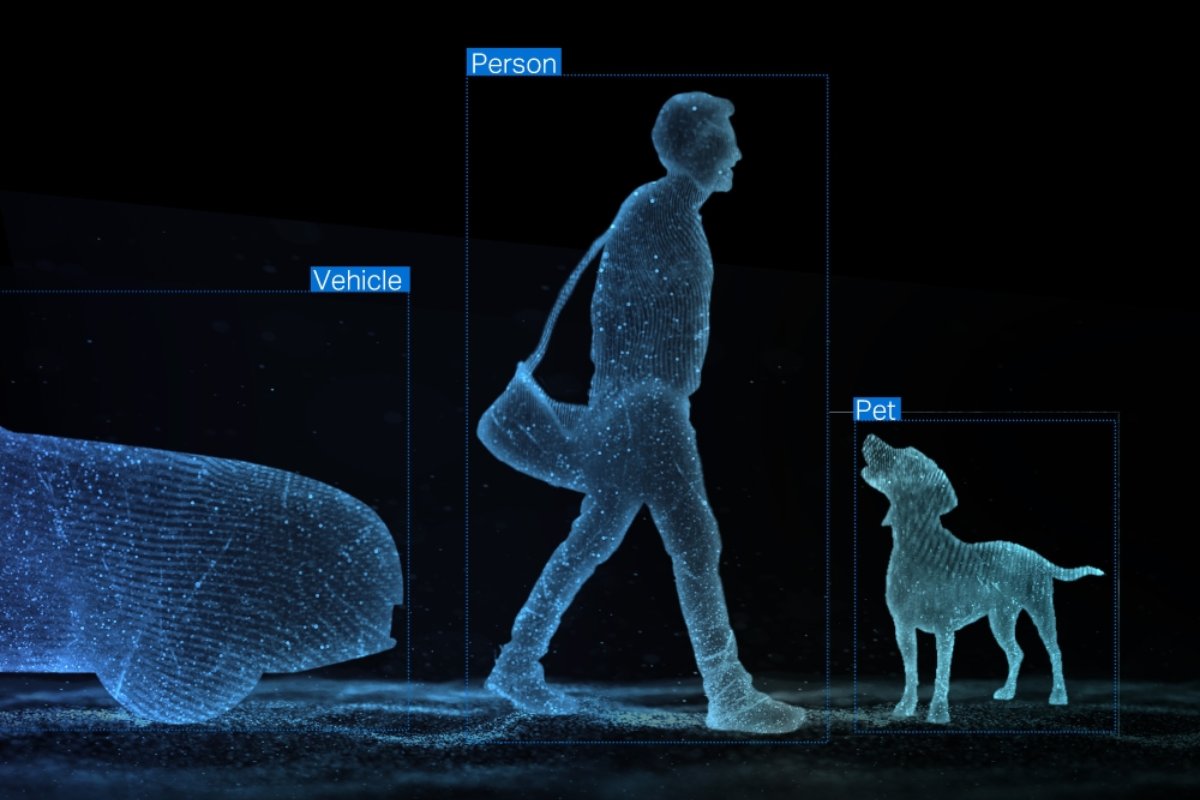

Az Apple, mint minden nagy informatikai szolgáltató, eddig is folyamatosan vizsgálta a felhasználók által feltöltött tartalmakat, hogy gyerekbántalmazást ábrázolnak-e - ennek a működéséről, illetve az ilyen rendszerek fejlődéséről nemrég írtunk a Rakétán. Ezt mostantól egy olyan mesterséges intelligenciával egészítik ki, amely a készüléken magán, vagyis nem a szervereken végzi az ellenőrzéseket.

Az Apple megkap egy adatbázist a gyermekvédelmi szervektől, amely tartalmazza az ismert pornográf fájlok ujjlenyomatait. Ezt egy bonyolult, és több szakértő szerint biztonságos eljárással titkosítják, majd letöltik az iPhone-okra, iPadekre, Mac-ekre. Ott aztán minden egyes felhasználói fotó kap egy tanúsítványt, ami rögzíti, hogy ismert jogsértő tartalom szerepel-e rajta. Amikor aztán a felhasználó feltölti a felhőbe a képeket, például, hogy biztonsági másolatot készítsen róluk, a rendszer értesíti az Apple-t, ha egy meghatározott mennyiségnél több aggasztó tartalmat talál.

Az Apple dolgozói ekkor és csak ekkor betekinthetnek a képekbe (ezt eddig is megtehették, ahogy minden más nagy felhőszolgáltatónál is), és ha valóban fennáll a probléma, jelzik a hatóságoknak.

Fékek, ellensúlyok, aggályok

Az Apple azt állítja, hogy egy az egybillióhoz a téves riasztás lehetősége, és egyetlen kép miatt egyébként sem fogják megkeresni a rendőrséget. Jogvédők ezzel szemben azzal vádolják Tim Cookékat, hogy "megfigyelő és cenzúrázó" rendszert fejlesztettek, sőt, "hátsó ajtót" építenek az operációs rendszereikbe - ami ellen eddig vehemensen tiltakoztak.

Azt mondják, hogy az már nem két végpont közti teljes, "end-to-end" titkosítás, ha a feladó tartalmait ellenőrzi egy rendszer, hiába fut az a telefonon, és nem egy központi számítógépen. És ami ma a gyerekpornográfia, az később, nem demokratikus országokban, például Kínában könnyen lehet más, a rendszer számára aggasztó tartalom.

A WhatsApp vezetője rögtön leszögezte, hogy nem fogják alkalmazni a rendszert, és szerintük rossz ötlet - de ehhez fontos hozzátenni, hogy az Apple és a WhatsApp anyacége, a Facebook közt történelmi háború zajlik épp, így nem meglepő, hogy az innovációnak a negatív oldalára fókuszálnak. Ezzel együtt, belső levelezésekben még Cupertinóban is aggódnak a megoldással kapcsolatos "félreértések" miatt.

Ez még nem minden

Az Apple a NeuralHash mellett az iMessage-et úgy fejleszti tovább, hogy a gyerekekhez érkező, vagy a gyerekek által küldött üzenetekben lévő meztelen fotókról akár a szülőknek is küldhető riasztás; illetve a jogsértő tartalmakra való Siri-keresések után is figyelmeztetésekkel fog találkozni a felhasználó. A változások rövidesen élesednek, de az, hogy az Apple-nek vagy a jogvédőknek lesz igaza, csak sokára fog eldőlni.

(Foto:Unsplash)