A megkérdezettek többsége Magyarországon nem akar gyilkolásra felhatalmazott robotokat látni az IPSOS legújabb felmérése szerint

Paul Scharre, az Egyesült Államok Védelmi Minisztériumának korábbi munkatársa, aki az automata rendszerekre és az újfajta fegyvertechnológiákra vonatkozó jogszabályok kidolgozásának feladatával volt megbízva, 2019-ben előadást tartott a Stanford Egyetemen.

Az előadás során felidézte azokat az iraki és afganisztáni akciókat, melyen az Army Rangers 3. zászlóaljának tagjaként vett részt még 2008 előtt. Egy alkalommal csapatukat felderítő misszióra küldték az afgán határra, hogy detektálják és leszereljék a helyszínen rejtőző tálib harcosokat. A területen azonban nem katonákat találtak, hanem egy kecskenyájat, mely körbevette őket. Az állatokat egy öt-hat év körüli kislány vezette, aki rádión jelentette a pozíciójukat a táliboknak. A háború szabályai szerint a gyerek ellenségnek számított, aki potenciálisan fenyegető helyzetbe hozhatja őket, így Scharre csapata elvileg fel volt hatalmazva arra, hogy lelője a kislányt. De ebben az esetben az erkölcsi, humanitárius elvek felülírták a harc törvényét, és a katonák nem gyilkoltak.

Mi lett volna, ha egy robotnak kell meghozni a döntést?

Meg lehet írni úgy egy algoritmust, hogy egyszerre több prioritást is figyelembe tudjon venni? Scharre szerint egy automata robot lőtt volna, ez pedig magával vonz néhány komoly kérdést: "Hogy tudsz úgy kialakítani egy robotot, hogy ismerje a különbséget aközött, ami legális és ami helyes? És egyáltalán hogy kezdesz neki, hogy leírd ezeket a szabályokat, még idő előtt? Mi van, ha nincs egy ember a helyszínen, hogy értelmezze ezeket, hogy az emberi értékek teljes készletet integrálja ezekbe a döntésekbe?[...]

Egy automatizált fegyver éppen annyira számít törvényes közvetítőnek, mint egy M16-os. Az embereket kötik a háború szabályai és ennek eleget kell tenniük."

A Scharre által feltett kérdések sok más helyen is napirendre kerülnek mostanában, de az országok más-más hozzáállást képviselnek a témával kapcsolatban. A nagy hadseregeket fenntartó államok, melyeknek megvan a kellő financiális és technológiai hátterük az automatizálás és high-tech hadseregnek kiépítésére, úgymint Kína, Oroszország vagy az Egyesült Államok, általában nem ellenzik az önálló döntéseket hozó drónok vagy más "gyilkos robotok" fejlesztését. Az Európai Unió képviselői, ettől eltérően, egy olyan törvényjavaslat megfogalmazását propagálják, mely tiltaná az emberi tényezőt a végső döntésből kizáró megoldásokat.

Az Állítsuk Meg a Gyilkos Robotokat Kampány (Campaign to Stop Killer Robots) egy 2012-ben indult, több, mint száz NGO szervezetet magában foglaló koalíció, mely a LAWS (lethal autonomous weapon systems) alkalmazása ellen küzd. Tagjai között találjuk az Amnesty Internationalt, a Human Rights Watch-ot vagy a Nők Nemzetközi Ligáját a Békéért és Szabadságért. A szervezetnek magyar ága is létezik, amely aktívan részt vesz a kampány hazai tevékenységében. A Campaign to Stop Killer Robots már évek óta rendszeresen megbízást ad az IPSOS piackutató intézetnek, hogy végezzenek széles körű felméréseket a lakosság körében az önálló döntéseket hozó, gyilkolásra alkalmas eszközökkel kapcsolatban. A felmérések eredményei szerint állandó és erős ellenérzés tapasztalható az olyan fegyverrendszerekkel szemben, amelyek emberi közbeavatkozás nélkül választanák ki és támadnák meg a célpontjaikat. 2017 januárja óta háromszor tették fel a kérdéseket összesen 23-28 ország 500-1000 lakosának.

Két kérdést tettek fel a résztvevőknek:

1. Az ENSZ vizsgálja a halálos autonóm fegyverrendszerek stratégiai, jogi és morális implikációit. Ezek a fegyverrendszerek képesek lennének emberi beavatkozás nélkül önállóan kiválasztani és megtámadni célpontjaikat. Így tehát különböznek a mai értelemben vett drónoktól, amelyek esetében emberek választják ki és támadják a célpontokat. Mit gondol az ilyen halálos autonóm fegyverek használatáról a háborúkban?

2. Ha elutasítja a halálos autonóm fegyverek használatát, ezt elsősorban mivel indokolja?

- Túlságosan drágának tartom

- Nem elszámoltathatók

- Morális határt lépnek át, mert a gépeknek nem lenne szabad ölniük

- Technikai meghibásodások lehetősége miatt

- Valami más

- Nem tudom

A tapasztalatok szerint az elvégzett felmérések között eltelt időben az elutasítás mértéke nem csökkent a válaszadók között.

A 2020-as felmérés szerint Magyarország az elsők között van a gyilkolásra is felhatalmazott robotok elutasítóinak sorában, nálunk 70% nyilatkozott negatívan ezekről az eszközökről,

Törökországban 73%, míg Svédországban 76%. Az ellenérzés legalacsonyabb Franciaországban (47%) és Indiában (36%). Sok helyen nőtt az előző évekhez képest a negatív hozzáállás mértéke: Brazíliában 16%-kal, Izraelben 12%-kal, Japánban 11%-kal és Dél-Afrikában 7%-kal többen vannak a robotok ellen. A legtöbb országban a nők egy kicsivel jobban ellenzik az ilyen típusú gépek bevetését, de nagyjából kiegyenlített az arány a két nem között (bár a férfiak 26%-a támogatja ezeket a fegyvereket, a nőknek csak 16%-a) viszont az életkor előrehaladtával nő az ellenérzés: a magyar nők 69%-a utasítja el a gyilkolásra felhatalmazott robotokat, generációs bontásban pedig (minden országra vetítve) a 18-35 éves generáció körében 54%, míg 50-től 64-ig 68%-uk.

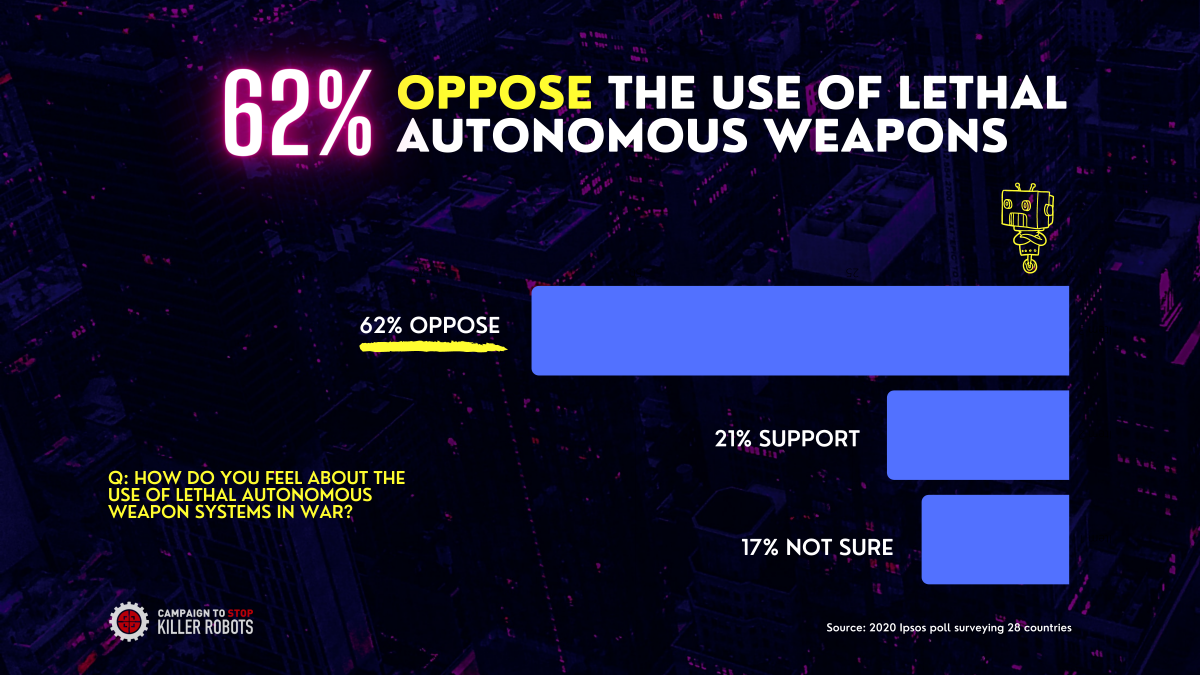

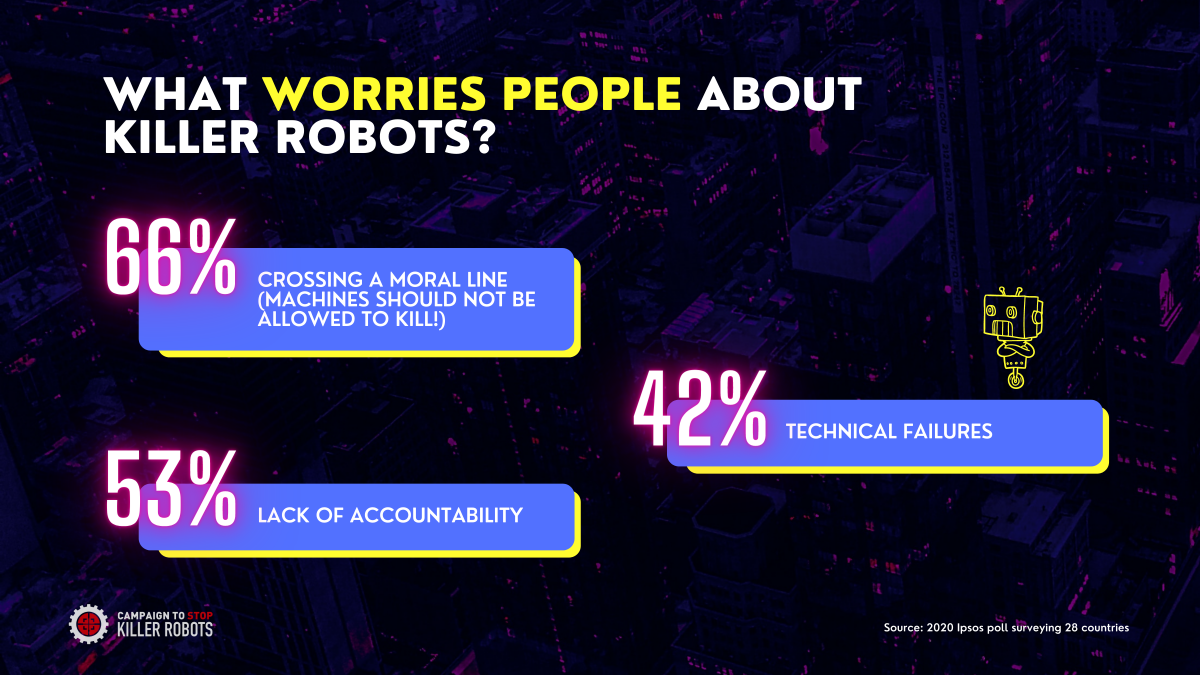

Az okok között a morális aggályoktól kezdve az esetleges meghibásodás miatti bizalmatlanságig több indok is szerepel. A válaszadók kétharmada (66%) szerint a gyilkolásra felhatalmazott robotok "morális határt lépnek át, mivel a gépeknek nem szabad megengedni, hogy öljenek”. Több, mint felük (53%) úgy gondolja, hogy a gépeket nem lehetne elszámoltatni, 42%-a pedig lehetséges technikai meghibásodásokra hivatkozva utasítja el.

Összeségében a felmérés rávilágított, hogy a megkérdezettek többsége elutasítja a halálos autonóm fegyverek használatát (62%), míg 21% támogatja és 17% nem tudja, melyik oldalon foglaljon állást. Ez azt jelenti, hogy öt emberből több, mint három ellenzi az ilyen fegyverrendszerek használatát.

(Fotó: Campaign to Stop Killer Robots, Flickr/stephenmelkisethian)

További cikkek a Rakétán:

Az Európai Parlament képviselői a mesterséges intelligencia által okozott apokalipszis elhárítására készülnek

Mindig az emberi lényeknek kell felelősnek lenniük, mikor életről és halálról döntenek, ezért a kontinensen fejlesztett MI nem lesz szuperintelligens, önálló döntéseket hozó entitás.

Az Európai Parlament képviselői a mesterséges intelligencia által okozott apokalipszis elhárítására készülnek

Mindig az emberi lényeknek kell felelősnek lenniük, mikor életről és halálról döntenek, ezért a kontinensen fejlesztett MI nem lesz szuperintelligens, önálló döntéseket hozó entitás.

Az államok véleménye az önállóan ölni képes gyilkos robotokról

Nem egészen megnyugtató, ahogy az országok az autonóm gyilkolászásra képes robotokról vélekednek.

Az államok véleménye az önállóan ölni képes gyilkos robotokról

Nem egészen megnyugtató, ahogy az országok az autonóm gyilkolászásra képes robotokról vélekednek.

Tényleg robotforradalmat ébresztett a pandémia?

"A robotok valóban arra hivatottak, hogy átvegyék az irányítást az éttermi konyhákban?" Tette fel a kérdést négy éve az Eater magazin. Vajon sikerült ezt megvalósítani az elmúlt négy évben vagy a robotok még mindig 'túl szexik'? És hogyan változtatta meg mindezt a koronavírus-járvány?

Tényleg robotforradalmat ébresztett a pandémia?

"A robotok valóban arra hivatottak, hogy átvegyék az irányítást az éttermi konyhákban?" Tette fel a kérdést négy éve az Eater magazin. Vajon sikerült ezt megvalósítani az elmúlt négy évben vagy a robotok még mindig 'túl szexik'? És hogyan változtatta meg mindezt a koronavírus-járvány?