WSE-3: a világ leggigászibb chipe nyolcszor gyorsabb AI szuperszámítógépet hajt a jelenlegieknél

A Cerebras Wafer Scale Engine 3 (WSE-3) chip óriási előrelépést jelent a számítástechnikában, mivel (egészen elképesztő szám következik): 4 billió tranzisztorból áll, vagyis négyszer 10 a 12-en tranzisztorból. Az akár sci-fi filmekben is látványosnak számító alkatrész a Condor Galaxy 3 szuperszámítógépet hatja majd, méghozzá nem is akárhogy: a jelenlegi számítási sebesség-csúcs nyolcszorosát is el lehet vele érni – írja a LiveScience.

Az említett szuperszámítógép, a Condor Galaxy 3 tervezett teljesítménye 8 exaFLOPS lesz, ami 8-szor 10 a 18-on műveletet jelent másodpercenként. Az exaFLOPS (vagy exaflops) egy mérőszám, amelyet arra használnak, hogy megmutassa, egy számítógépes rendszer mennyire képes gyorsan számolni – a betűszó feloldásával a “floating-point operations per second” (vagyis FLOPS) ugyanis azt méri, hány lebegőpontos (vagyis tizedestörtekkel végzett) számítást tud végrehajtani egy számítógép másodpercenként. Tehát, amikor azt mondjuk, hogy a Condor Galaxy 3 képes lesz 8 exaFLOPS teljesítményre, azt jelenti, hogy képes lesz 8 trillió (ez egy 8-as, ami után 18 nulla áll) művelet végrehajtására másodpercenként.

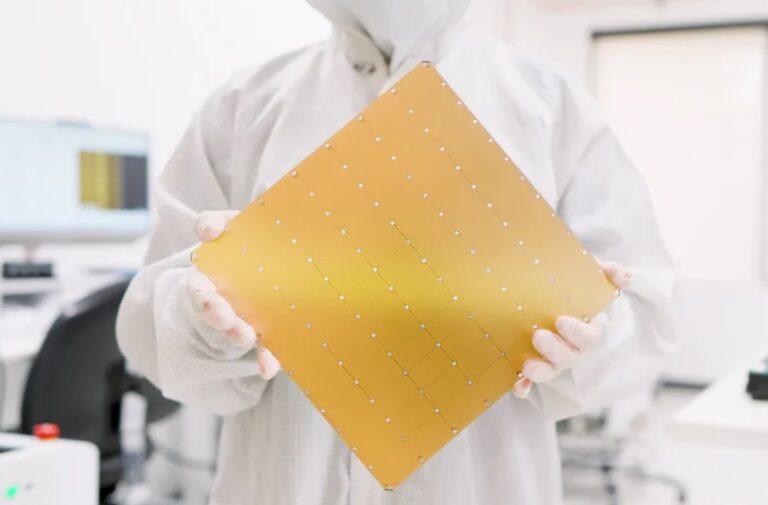

A WSE-3 chip a maga nemében a legnagyobb a világon, és az architektúráját úgy tervezték, hogy felgyorsítsa a mesterséges intelligencia (AI) számításait, javítva az OpenAI GPT-4-éhez és az Anthropic Claude 3 Opusához hasonló rendszereket. Mindezt úgy, hogy az elődhöz, a WSE-2-höz képest a chip fizikai dimenziói változatlanok maradt, tehát ez is 21,5 x 21,5 centiméteres. A 900 ezer AI maggal rendelkező WSE-3 ráadásul az energiafogyasztás tekintetében is megegyezik az elődjével, miközben kétszeres számítási teljesítményt kínál. A kontextus kedvéért tegyük hozzá azt is, hogy a hasonló célokat szolgáló Nvidia chip, a H200 “mindössze” 80 milliárd tranzisztorból áll, ami tehát 57-szer kevesebb, mint amennyi a WSE-3-ban található.

Érdekesség, hogy ez a fejlődés pontosan megfelel a Moore-törvénynek, amely szerint körülbelül kétévente megkétszereződik a tranzisztorok száma egy chipen.

A jelenleg Dallasban (Texas állam) fejlesztés alatt álló Condor Galaxy 3 szuperszámítógép 64 darab Cerebras CS-3 AI rendszerből fog állni, és ezek mindegyikét egy WSE-3 chip hajtja majd. Ez a gép kiegészülve a Condor Galaxy 1 és 2 elődökkel együttesen 16 exaFLOPS teljesítményre képes hálózattá építhető, ami példátlan a számítástechnika terén.

Mindez azonban nem csak pőre rekord, hanem a rendszer új lehetőségeket nyit meg a mesterséges intelligencia rendszerek fejlesztésében: lehetővé teszi, hogy a jelenlegieknél sokkal nagyobb AI modelleket képezzenek. Amíg például ugyanis a ChatGPT-4 körülbelül 1,76 trillió paramétert használ, a Condor Galaxy 3-mal akár 24 trillió paraméterrel rendelkező AI modelleket is létre lehet hozni. És hogy ezek a számok konkrétan mit jelentenek? Új fejezetet a mesterséges intelligencia egyébként is rohanó történetében.

(Kép: Cerebras)