"A mesterséges intelligencia terén nem csupán szerencsés, ha megvan a bizalom, hanem egyenesen elengedhetetlen. Ezekkel a mérföldkőnek számító új szabályokkal az EU élen jár az olyan új globális normák kidolgozásában, amelyekkel biztosítható a mesterséges intelligencia iránti bizalom" – ezekkel a szavakkal jelentette be Margrethe Vestager, a digitális korra felkészült Európáért felelős ügyvezető alelnök tavaly áprilisban a mesterséges intelligenciát szabályozó törvényt.

A tervezet szerint az EU kockázat-alapon fogja besorolni az MI rendszereket: az "elfogadhatatlan" kategóriába a felhasználókat manipuláló, illetve a Kínából ismert "társadalmi pontozást" lehetővé tevő szoftverek tartoznak; a "magas" kockázatba például a közlekedéssel, az oktatással, a biztonsággal, a bűnüldözéssel vagy az igazságszolgáltatással kapcsolatosak, illetve az összes távoli biometrikus azonosító rendszer; a "korlátozott" csoportba a chatbotok (csevegőrobotok); "minimális" kockázatot pedig a spamszűrők vagy a videojátékok jelentenek.

A TechCrunch-on most Natasha Lomas elemezte a javaslatot az Ada Lovelace Intézet szakértőjével, a Newcastle-i Egyetem joggal, innovációval és társadalommal foglalkozó munkatársával, Lilian Edwards-zal. Edwards szerint a keretrendszer korlátait részben az adja, hogy a meglévő termékszabályozásokhoz hasonló megközelítést alkalmaz. Vagyis az MI törvény leginkább a "gyártót", azaz a rendszer fejlesztőjét szabályozza, miközben az ilyen szoftvereknél az alkalmazás módja, például, hogy milyen adatokon trenírozzuk és mikor vetjük be azokat, nagyban befolyásolja, hogy jogszerű-e a felhasználásuk. Egy életveszélyes bicikliről már a gyártáskor be lehet bizonyítani, hogy veszélyes, egy mesterséges intelligenciáról nem biztosan.

A szakértő szerint a rendszer teljes életciklusa alatt változik, hogy kik a felelősek a működéséért – aminek a meghatározása szerinte is "szélsőségesen nehéz" feladat. Egy további gyenge pont Lilian Edwards szerint az, hogy a törvény nem ad lehetőséget az állampolgároknak, illetve állampolgárok csoportjainak, hogy jogorvoslatért a hatóságokhoz fordulhassanak – miközben az adatvédelmi kérdéseket szabályozó GDPR ezt például lehetővé teszi. Edwards szintén hiányolja azokat a területeket, amelyek a digitális piacokról és szolgáltatásokról szóló jogszabályok alá tartoznak, például a keresők és a közösségi oldalak profilalkotó MI rendszerei. Mindezzel együtt a javaslatot

"a holisztikus MI-szabályozás kiváló kiindulópontjának"

nevezi. Szerinte a piacokat felügyelő hatóságok, amik valószínűleg az adatvédelmi hatóságok lesznek, minden szükséges lépést megtehetnek ahhoz, hogy egy MI jogkövető legyen, akár elrendelhetik az újratrenírozását vagy teljes egészében kivonhatják a piacról. "A veszélyes játékokat is vissza tudod hívni a piacról, illetve bizonyos EU országokban megsemmisítheted azokat. Nem csak megtiltod az importjukat. Meg tudod semmisíteni azokat. A (hatóságok kapta) lehetőségek erre emlékeztetnek." Vagyis a szakértő szerint a szabályozás nem tökéletes, de ígéretes. A törvény végleges szövege a Bizottság és a Parlament egyeztetései után, 2023-ban születhet meg.

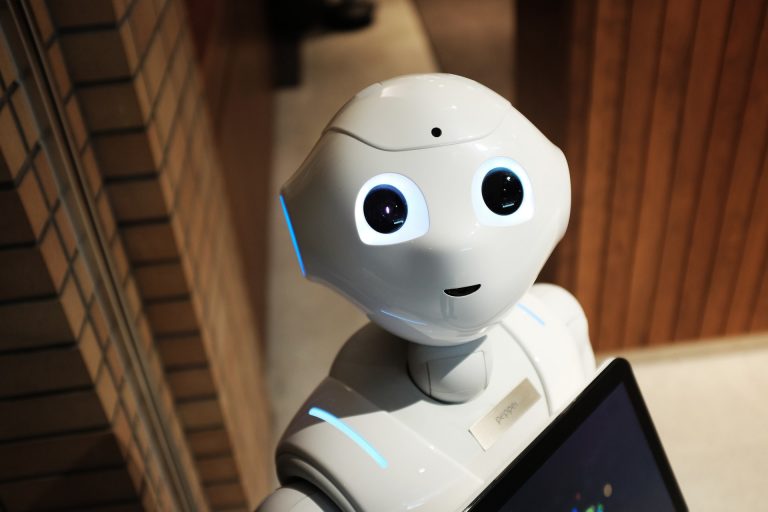

(Fotó: Alex Knight / Unsplash)

Itt állíthatod be, hogy a Rakéta az elsők között legyen a Google keresőben