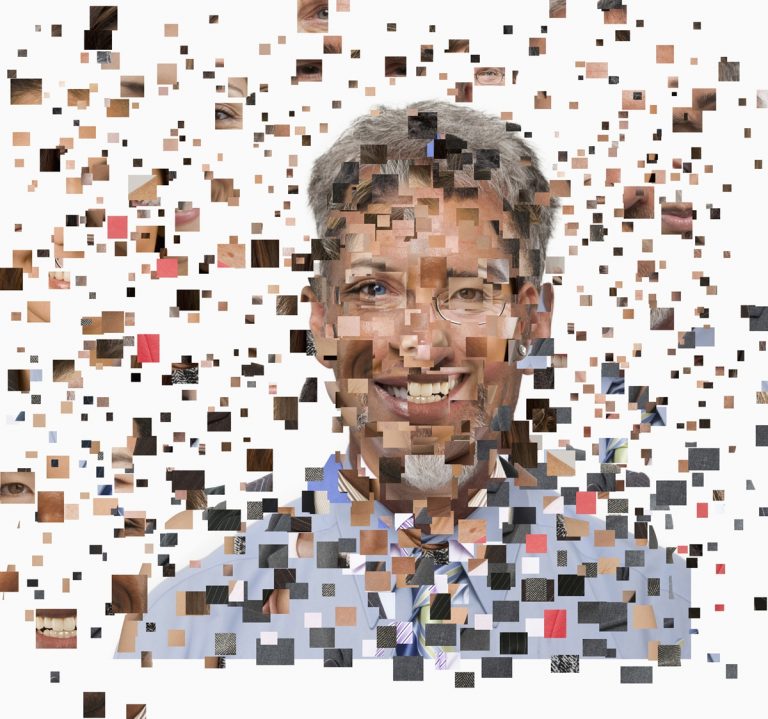

Csaknem kétszáznegyvennégyezer arcképet összemosott a mesterséges intelligencia

Az azóta eltelt lassan tíz év alatt az ImageNet tárhelye másfél milliósra duzzadt, és körülbelül ezer címkét tartalmaz, sőt a The Verge korábbi cikke szerint a tárgyak szegmentálásában, a tárgy és a háttér szétválasztásában 2015 és 2018 között hetvenkét százalékot fejlődtek a programok. Manapság pedig nagyrészt a gépi tanulási algoritmusok teljesítményének felmérésére vagy speciális számítógépes látási feladatokat ellátó algoritmusok képzésére használják: a jelenlegi arcelmosásos projektben összesen 243 198 fotóról beszélünk.

De mi késztette erre a kutatókat?

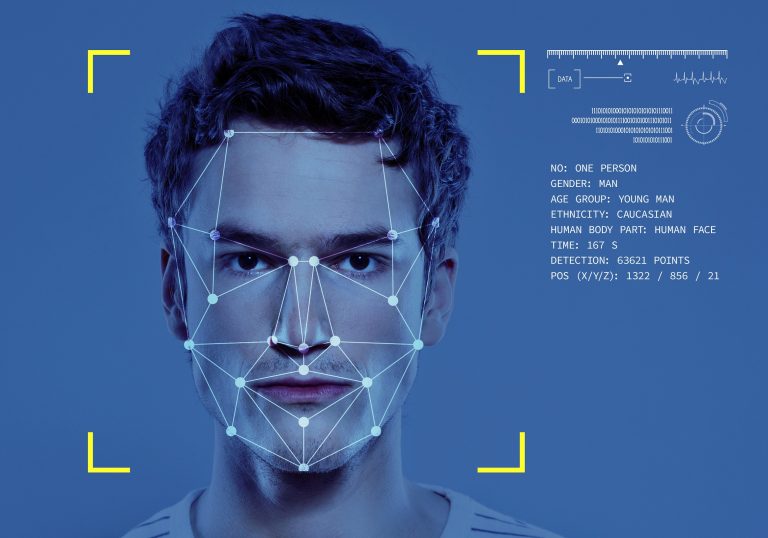

Olga Russakovsky, a Princetoni Egyetem adjunktusa és az ImageNet kezeléséért felelős csapat tagja a Wired-nek beszélt adatvédelemmel kapcsolatos aggályaikról. Mert bár a mesterséges intelligencia fejlődéséből adódóan az arcfelismerő szoftverek képességei is jelentősen javultak az elmúlt évtizedben, ettől függetlenül időről időre napvilágot látnak olyan elemzések, amelyek – faji, etnikai vagy életkori – diszkriminációval vádolják a technológiát. Arvind Krishna, az IBM vezérigazgatója ennek kapcsán a The Verge munkatársának beszélt arról, hogy az eszközök emiatt még

nem elég megbízhatók ahhoz, hogy bűnüldözési vagy biztonsági célokra használják, és könnyen polgárjogi jogsértést generálhatnak.

Na és természetesen ott vannak az adatvédelmi jogi kockázatok, amelyek mindenekelőtt a biometrikus adatok egyediségéből származnak, vagyis azok közvetlenül az egyénhez kötődnek, az arcfelismerő technológiák miatt azonban sérülhet a magánélet védelme, és rosszabb esetben visszafordíthatatlan károkat okozhat az egyes személyeknek. Egyes régiókban pontosan ezért tiltották be az arcfelismerő szoftverek használatát, ahogy az is emlékezetes momentum volt, amikor a detroiti rendőrség beismerte, hogy arcfelismerő technológiájuk kilencvenhat százalékban téved.

Russakovsky szerint csapatuk kíváncsi volt, hogy elhomályosíthatók-e az arcok az adatsorban úgy, hogy az algoritmus továbbra is felismerje az objektumokat, vagyis szétválasztja a tárgyat a háttértől. Elmondása szerint esetükben a fotókon szereplő arcok csupán "mellékszereplők" voltak, őket ugyanis az érdekelte, hogy ha mondjuk egy sörösüvegből ivó személyt ábrázoló képen elhomályosítják az emberi alakot, attól az üveg még továbbra is sértetlen marad, azaz felismeri a program. Az ImageNet egy kutatást is közzétett a projekt kapcsán, melyben többek között arról is beszámolnak, hogy az arcok összemosását a Rekognition nevű arcfelismerő algoritmussal hajtották végre, feldolgozásukért pedig az Amazon Mechanical Turk nevű crowdsourcing munkaerő-közvetítőt bízták meg. Az arcok elmosása végül nem befolyásolta az objektumfelismerő algoritmus teljesítményét - állítják a kutatók. Valamint arra is rámutattak, hogy az ezen objektumfelismerő algoritmusok alapján felépített más algoritmusokra sincsenek hatással. Russakovsky reményei szerint kutatásuk előfutára lehet egy biztonságosabb adatgyűjtési metódusnak.

Egy kis háttérinformáció a Rekognition-ről

Tavaly júniusban jött a hír arról, miszerint az Amazon egy évre letiltja a Rekognition arcfelismerő algoritmus használatát az amerikai rendőrök számára, ezzel az IBM után újabb teches nagyvállalat hozott jelentős, részben politikai üzenetet hordozó döntést. (Bizonyára még mindenki jól emlékszik, hogy tavaly nyáron az USA meglehetősen felbolydult a George Floyd halálát követő, rasszizmussal kapcsolatos zavargások következtében).

Az Amazon nem nevezte meg konkrétan döntésének kiváltó okát,

mindössze annyit közölt, hogy a következő egy évben a törvényhozás remélhetőleg egy átfogóbb, a technológia felhasználásainak kereteit pontosan megszabó szabályozást alkot. Illetve hozzátette, az arcfelismerő platformot eltűnt személyek felkutatására továbbra is használhatják. A zavargások kezdetén a demokrata képviselők elő is terjesztettek a Kongresszusnak egy, a rendőrség működésével kapcsolatos reformtervezetet, mely többek között megtiltja, hogy a rendőrök által viselt, vagy a gépjárművekre szerelt kamerák előzetes bírói jóváhagyás nélkül valós idejű arcfelismerést végezzenek. Egyes elemzők szerint ugyanakkor az Amazonnak is jócskán dolgoznia kellene a Rekognition javításán, már csak azért is, mert egy 2018-as vizsgálat során kiderült, hogy a program sötétebb bőrtónusú személyeknél lényegesen többször téveszt, beleértve a nemek meghatározását is. Az Amazon akkor azzal védekezett, hogy a Rekognition folyamatos tanulási fázisban van,

emiatt valószínűleg sosem lesz száz százalékos pontosságú.

Ha pedig már a rasszizmusnál tartunk, az ezzel kapcsolatos incidensek az ImageNet-et sem kerülték el: 2019-ben kiderült ugyanis, hogy az adatbázis címkéi között trágár, sértő kifejezések is előfordultak, nők képeinél például a kurva, a kisebbségek kapcsán pedig rasszista becsmérlések.

(Fotó: Getty Images Hungary, Pixabay)