Az Európai Parlament képviselői a mesterséges intelligencia által okozott apokalipszis elhárítására készülnek

Az Európai Parlament január 20-i plenáris ülésén a jelenlévő EP tagok többsége, 364 képviselő támogatásával, 274 ellenszavazattal elfogadta azt a jelentést, mely az európai mesterséges intelligencia rendszerek világosabb szabályozásának érdekében egy olyan keretrendszer létrehozását sürgeti, mely a jövőben biztosíthatja, hogy világos és etikus elvek vezéreljék a kontinensen fejlesztett és használt mesterséges intelligenciát. Mivel általában elmondható, hogy a szabályozások rendszerint a fejlesztések mögött kullognak sok olyan, az emberiséget közvetlenül érintő nagy kérdéskörrel kapcsolatban, amely potenciális károkat okozhat rossz kezekbe kerülve, úgymint a génszerkesztés, a deepfake megjelenése, az arcfelismerő megfigyelőrendszerek széleskörű alkalmazása, az egyre önállósodó harci robotok, ezért a MI-val kapcsolatban ideje még azelőtt lefektetni bizonyos irányelveket és meghúzni a határokat, mielőtt végleg kikerül az irányítás alól.

Ez az európai MI fejlesztés tekintetében azt jelenti, hogy egy emberközpontú attitűdöt érdemes elsajátítani, hogy a végső döntések mindig az emberi értékeket, illetve a kontinensen az európai értékeket tükrözzék

- írja a jelentés.

Gyilkos robotok

A szabályozásra nagy szükség lehet az elmúlt időszak eseményeinek fényében, nemrégiben került terítékre például a kérdés, hogy vajon mennyire bölcs dolog önállóan gyilkoló robotokat alkotni. A Human Rights Watch emberjogi szervezet, amely 2013 óta folytat kampányt a témában "Campaign to Stop Killer Robots" néven, tavaly augusztusban publikálta a különböző országok hozzáállását feltérképező vizsgálat eredményeit, ami nem fest olyan megnyugtató képet a helyzetről. Míg egy lehetséges robotháború kétségkívül megkímélné sok katona életét, ez a fajta hadviselés egyben levenné a felelősség terhét az emberekről és könnyebben elfogadhatóvá és emészthetővé tenné a harcokat, ezzel pedig potenciálisan aláásná a békéért tett erőfeszítéseket.

Arról nem is szólva, hogy a terroristák kezében milyen pusztítás vihetne végbe egy kontrollálhatatlan géphadsereg.

A jelentés éppen ezért hangsúlyozza a jelentőségét, hogy az EU vállaljon vezető szerepet nemzetközi szinten is a MI alkalmazások globális keretrendszerének promotálásában.

Genfi Egyezmény robotoknak

A jövőbeli szabályozásnak mindenképpen egybe kell esnie az 1949 augusztus 12-én elfogadott Genfi Egyezménnyel, valamint a '98-as Római Egyezménnyel is, amely tiltja a népirtást és a háborús bűnöket, tisztelnie kell az Európai Uniót megalapozó alapvető szabadságjogokat és nem jelenthet kibúvót a tagállamok számára a felelősség alól. A képviselők véleménye szerint fontos, hogy a mesterséges intelligencia mindig álljon emberi ellenőrzés alatt, akinek így lehetősége lesz rá, hogy "korrigálja, megállítsa vagy inaktiválja azt, váratlan magatartás, véletlen beavatkozás, kibertámadás vagy harmadik fél általi közbelépés esetén." Ha egy ember hozza meg a végső döntéseket, a gép a szolgáló pozíciójában marad, nem lép feljebb a hierarchiában és válik a végén mesterré és a robotok megalkotásának ez is a fő célja.

Igaz, hogy így a mesterséges agyak potenciálja nem lesz teljeskörűen kiaknázva, viszont a felelősség kérdése nem veszik el a ködös etikai irányelvek labirintusában: aki irányítja a robotot, azé a felelősség.

A szokatlan hadviselési formákra, mint amilyen a kiberháború, a hagyományos konfliktusokat meghatározó feltételek kell, hogy vonatkozzanak. A gyilkos robotokat pedig kifejezetten be kell tiltani az Európai Unióban. Az úgynevezett LAWS, lethal autonomous weapon systems bevetésének a legvégső eszköznek kell lennie, de, "tekintve, hogy mindig az emberi lényeknek kell felelősnek lenniük, mikor életről és halálról döntenek, úgy hisszük, hogy a humán kontroll nélküli rendszereket (‘human off the loop’) minden körülmények között és kivétel nélkül be kell tiltani." Azt a jelentés szerzői is elismerik, hogy a LAWS fejlesztésével igencsak igyekeznek a nagyobb hadsereget fenntartó országok, hiszen egyértelmű előnyökkel jár számukra, ha gyorsabbak és hatékonyabbak lehetnek ezen a területen, az innovációkat pedig titkosítással védik, így nehéz belesni a színfalak mögé. Így pedig jóval előtte járnak a törvényeknek, hiszen egy egységes, univerzális, jogi szabályozás egyelőre nemhogy nem került még bevezetésre, de még csak a kidolgozás fázisában tart, amit az említett titkosítás is nehezít, mivel így nem lehet tudni, hogy pontosan milyen technológiákra is kéne egyáltalán szabályokat alkotni.

Jövőbeli stratégia

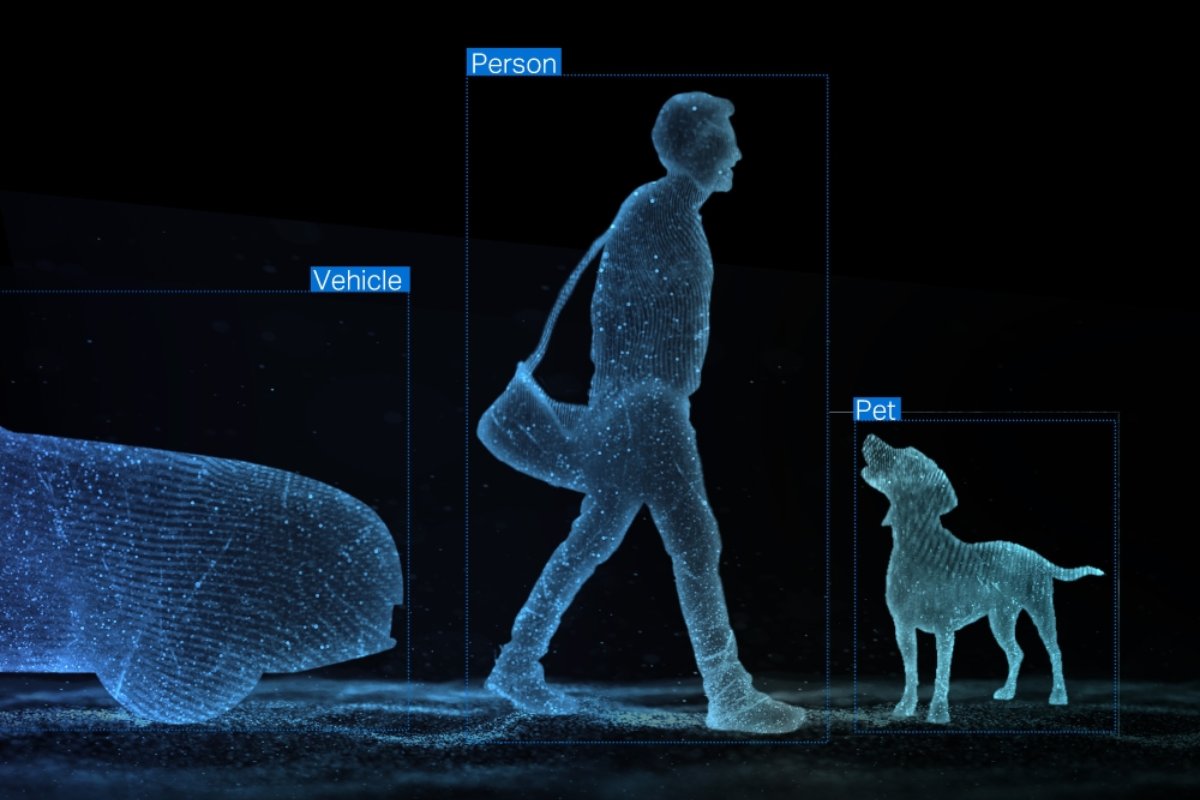

Azt sem titok, hogy jelenleg a mesterséges intelligencia ökoszisztémát nem annyira az európai szereplők, sokkal inkább amerikai és kínai digitális nagyhatalmak uralják, ezért, amennyiben nem akarunk végleg lemaradni, a kutatás-fejlesztésében, az ipari alkalmazásban és a saját források kiaknázásában is előre kell lépni. A mesterséges intelligencia ellentmondásos alkalmazásaival kapcsolatban, úgy mint az arcfelismerő szoftverek használata, a képviselők azt javasolják, érdemes a használatot egészen addig felfüggeszteni köztereken, iskolákban, egészségügyi intézményekben, repülőtereken, amíg nem születik egy egységes technikai sztenderd, amely teljesen mentes a diszkriminációtól és az elfogult ítéletektől.

A jelentés még sok más területre is kitér, kezdve az egészségüggyel (a hippokratészi esküvel összeegyeztethetőnek kell lennie a MI használatának), az algoritmusok átláthatóságán át a közlekedésben való alkalmazásig (ezen a területen nagyon is promotálják a mesterséges intelligencia megjelenését, a közlekedési eszközök forgalmának összehangolására és a dugók megszüntetésére például), ez is jelzi, hogy a mesterséges intelligencia már most is mennyire átszövi a hétköznapjainkat. A jelentés rapporteur-e, vagyis előadója, Gilles Lebreton elmondta: "Hogy előkészítsük a Bizottság jogi ajánlásait a témával kapcsolatban, ezzel a jelentéssel szeretnénk egy keretet megadni, mely lényegében felidézni, hogy bármely szektorban, de különösen a hadi vagy állam által irányított területeken a MI mindig eszköz kell, hogy maradjon, amely asszisztál a döntéshozatalhoz és segít a cselekvésben.

Soha nem válthatja fel az embereket vagy veheti le a felelősséget a vállukról."

(Kép: Flickr/nathaninsandiego, Pixabay)

Ez is érdekelhet:

Az Európai Bizottság az arcfelismerő rendszerek öt éves betiltását tervezi

A kiszivárgott dokumentumok alapján a Bizottság úgy véli, mivel a technológia nagy hatással lesz a jövőnkre, ideje alaposabban felülvizsgálni az ezzel kapcsolatos problémákat és egységes szabályozást létrehozni. Addig is átmenetileg beszüntetnék a rendszerek használatát. A tervet hivatalosan a jövő hónapban prezentáljak.

Az Európai Bizottság az arcfelismerő rendszerek öt éves betiltását tervezi

A kiszivárgott dokumentumok alapján a Bizottság úgy véli, mivel a technológia nagy hatással lesz a jövőnkre, ideje alaposabban felülvizsgálni az ezzel kapcsolatos problémákat és egységes szabályozást létrehozni. Addig is átmenetileg beszüntetnék a rendszerek használatát. A tervet hivatalosan a jövő hónapban prezentáljak.

Kína önállóan gyilkoló drónokat árul (a Google-nak pedig rossz hete van)

Képzeljük el: gyilkos katonai robotok, melyek emberi jóváhagyás nélkül támadhatnak bármire.

Kína önállóan gyilkoló drónokat árul (a Google-nak pedig rossz hete van)

Képzeljük el: gyilkos katonai robotok, melyek emberi jóváhagyás nélkül támadhatnak bármire.

Tíz napot töltött börtönben, mire kiderült: tévedett az arcfelismerő szoftver

A férfi most pert indított a rendőrség, az ügyészség és az önkormányzat ellen.

Tíz napot töltött börtönben, mire kiderült: tévedett az arcfelismerő szoftver

A férfi most pert indított a rendőrség, az ügyészség és az önkormányzat ellen.